주의! Caution!

해당 게시글은 Archive된 게시글 입니다.

Archive된 사유는 다음 중 하나에 해당 됩니다.

Archive된 사유는 다음 중 하나에 해당 됩니다.

- 작성 된지 너무 오랜 시간이 경과 하여, API가 변경 되었을 가능성이 높은 경우

- 주인장의 Data Engineering으로의 변경으로 질문의 답변이 어려워진 경우

- 글의 퀄리티가 좋지 않아 글을 다시 작성 할 필요가 있을 경우

이번 시간에는 Deep Learning의 Network들을 정리 해 보는 시간을 가져보겠습니다.

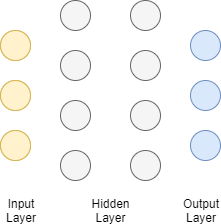

DNN(Deep Neural Network)

**심층 신경망(Deep Neural Network)**는 딥러닝의 가장 기본이 되는 신경망이며, **입력층(input layer)**과 출력층(output layer) 사이에 여러개의 **은닉층(hidden layer)**으로 이루어진 모델입니다.

DNN

장점

사실, 딥러닝의 장점이라고 할 수 있습니다.

- 일반 머신러닝과 다르게 딥러닝을 통해 학습하면, 데이터가 많으면 많은 만큼 정확한 결과를 나타냅니다.

- 비선형적인 문제들을 해결 할 수 있습니다.

- Feature Extraction이 자동으로 수행 됩니다.

단점

이도 마찬가지로, 딥러닝의 단점이라고 볼 수 있습니다.

- Overfitting의 문제가 발생 합니다.

- 시간이 오래 걸립니다.

- Feature Extraction을 통해 추출 한 가중치의 의미를 해석 하기 힘듭니다.

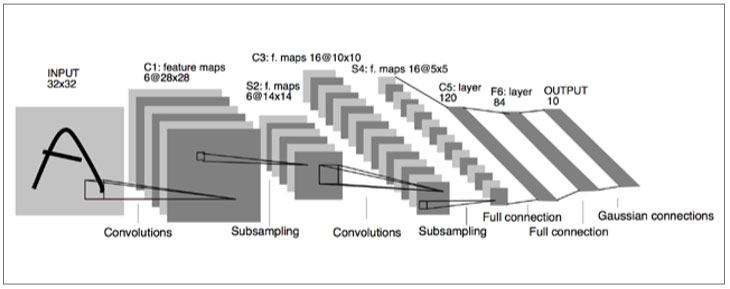

CNN(Convolutional Neural Network)

**CNN(Convolutional Neural Network)**은 합성곱 신경망이라고도 불리며 이미지, 텍스트와 같은 데이터의 형상 정보를 유지하여 학습 한다는 점에서 자주 사용되는 신경망 중 하나 입니다.

- 합성곱층(Convolutional Layer): 입력 데이터의 형상을 유지하여, 다음 레이어에 전달 하는 역할을 합니다.

- 필터(filter): 합성곱층의 가중치 파라미터에 해당하며, 커널(Kernel) 이라고도 합니다. 합성곱층의 특성을 추출하는 역할을 합니다.

- 수용영역(Receptive Field): 필터의 크기라고 할 수 있으며, 담으려고 하는 형상의 크기 라고도 할 수 있습니다.

- 패딩(Padding): 합성곱 연산 시행 전, 입력 데이터의 가장 자리를 채우는 것을 의미 합니다.

- 스트라이드(Stride): 필터 적용시, 필터가 이동하는 간격을 의미 합니다.

DNN

장점

- 형상 정보를 추출 할 수 있습니다.

- 이미지 학습에 매우 강력합니다!

- 학습 파라미터가 매우 작습니다!

단점

- 지역적인 정보를 추출 하는데에 집중 되어, 먼 곳에 떨어져 있는 데이터의 특성을 추출 하기 힘듭니다.

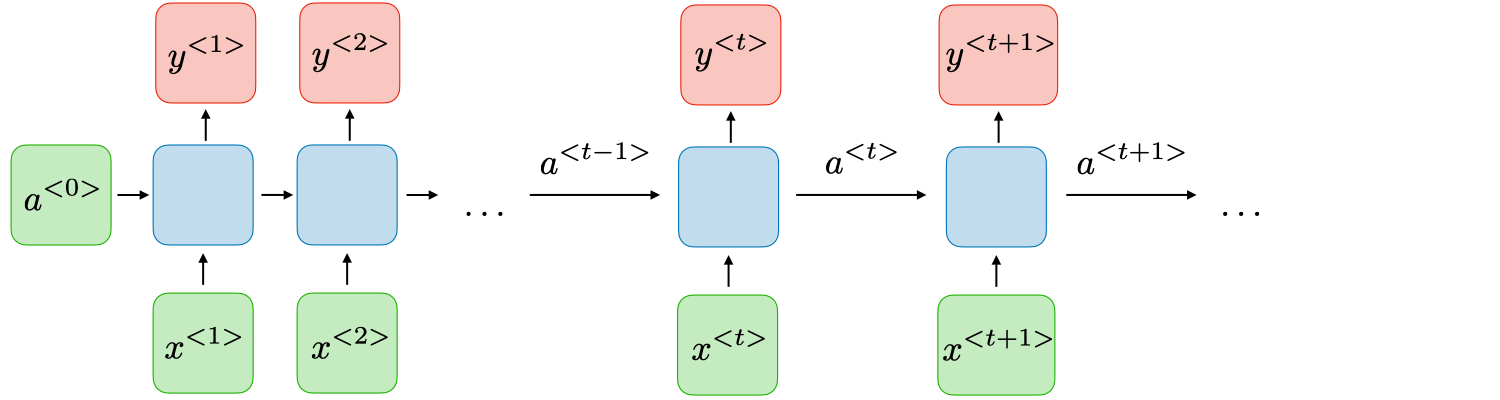

RNN(Recurrent Neural Network)

**RNN(Recurrent Neural Network)**은 순환 신경망 이라고도 하며, 음성, 텍스트 같이 순서가 있는 데이터를 모델링 하기 위해 등장 하였습니다. 순환이 가능 하여, 시퀀스 길이에 관계없이 인풋과 아웃풋을 받아들일 수 있습니다.

RNN

장점

- 순서가 있는 데이터에서 유의미한 결과를 도출 해 낼 수 있습니다!

- 음성, 텍스트 학습에 매우 강력합니다!

- 학습 파라미터가 매우 작습니다!

- 입력 데이터, 출력 데이터 크기에 구애를 받지 않습니다!

단점

- 시간이 매우 오래걸립니다.

- 문맥상 거리가 멀 경우, 기울기 소실 이슈가 발생 합니다.

Deep Learning Summary 시리즈의 다른 글

2020-09-19

2020-09-13

Recent Posts in Deep-Learning Category